8.1 ANÁLISIS DE DATOS

Una vez recogidos los datos procederemos a su análisis. Los resultados del estudio deben resumirse claramente para permitir su análisis e interpretación adecuados. Los datos se analizan en función de la finalidad del estudio, según se pretenda explorar o describir fenómenos o verificar relaciones entre variables. La primera tarea es describir los datos, los valores o las puntuaciones obtenidas para cada variable.

Necesitamos servirnos de técnicas para organizar los datos sobre todo en aquellos casos donde estos sean muy voluminosos. En la actualidad, el análisis cuantitativo de los datos se lleva a cabo mediante software especializados.

No obstante, es necesario una comprensión previa del proceso para poder realizarlo. Una desventaja de la informatización es que puede crear en los investigadores una confianza ciega en la estadística como una ciencia exacta y precisa. La estadística se basa en probabilidades y no en certidumbres. Necesitamos, por lo tanto:

- Conocer detalladamente cada una de las variables utilizadas en la investigación, incluyendo distribuciones de frecuencias, estadísticos univariantes y representaciones gráficas (Estadística descriptiva).

- El análisis de las relaciones bivariantes o relaciones entre variables. Existen diferentes técnicas en función de la escala en la que se ha medido cada variable (nominal, ordinal, intervalo, razón: diferencias de porcentajes, diferencia de medias, relación significativa entre variables, etc.). (Estadística inferencial, bivariante).

- El Análisis Multivariante. Analizar conjuntamente más de 2 variables. Modelización-Multivariante. Elaborar modelos, ecuaciones o funciones que permitan explicar unas variables a partir de otras, mediante programas informáticos.

Los investigadores deberán familiarizarse con los términos estadísticos para poder manejarse bien con ellos. En los estudios a gran escala, deben buscarse desde el comienzo el asesoramiento y la ayuda de un estadístico profesional. Sin embargo, el investigador es quien conoce el tipo de datos y las preguntas que hay que responder, y quien debe captar plenamente los conceptos que hay en el fondo de los cálculos estadísticos, y el significado y las limitaciones del ejercicio. Comprender los factores que hay que tener en cuenta al decidir sobre la prueba apropiada que va a emplearse, y la lógica común que hay detrás de las pruebas.

En los estudios epidemiológicos el análisis se realiza utilizando la estadística, mientras que en los estudios cualitativos se utiliza principalmente un análisis inductivo.

El análisis estadístico se planificará, empezando por la estadística descriptiva y siguiendo por la analítica, con estimación de medidas de riesgo, impacto, validez o precisión y contrastes de hipótesis.

Descriptivo, contempla las medidas de frecuencia de variables discretas y medidas de centralización y dispersión de variables continuas, (media/mediana, desviación típica/rango intercuartílico). Asimismo, se incluyen aquí la estimación de medidas de frecuencias de enfermedad (prevalencia, incidencia acumulada, densidad de incidencia, etc.). Todas las estimaciones deberán acompañarse de sus intervalos de confianza del 95%.

Analítico, el análisis implica comparación entre variables o grupos. La elección de la medida de riesgo, impacto, validez o precisión más adecuada para cada tipo de estudio, así como el texto estadístico más adecuado para cada análisis, se abordará en próximos capítulos del libro. El principal criterio a considerar en la elección es el tipo de escala de medida que siguen las variables analizadas. Las principales opciones serían:

- Medidas de riesgo/ impacto/ validez/precisión.

o Medidas de riesgo, riesgo relativo/ ratio/ cociente de riesgos instantáneos, azar, ratio, etc.

o Medidas de impacto, riesgo o proporción atribuible o prevenible.

o Eficacia/efectividad de procedimientos terapéuticos, reducción absoluta del riesgo, número necesario a tratar.

o Validez, sensibilidad, especificidad, cocientes de probabilidades, áreas bajo la curva ROC.

o Precisión, concordancia, índice, capa, coeficiente de correlación, intra clase, etc.

- Contraste de hipótesis, opciones más frecuentes.

o Dos variables discretas: Test de Jhi cuadrado o pruebas exactas (Fisher)

o Contraste de medias: test de la T de Student, análisis de la varianza o pruebas no paramétricas alternativas.

o Supervivencia: función de supervivencia, (Kaplan Meier)

o Correlación entre variables cuantitativas: coeficiente de correlación. Pearson o Spearman.

o Métodos de ajuste multivariante, regresión lineal múltiple (variable dependiente continua), regresión logística (variable dependiente discreta) o regresión de Cox (supervivencia).

8.2 ETAPAS DEL ANÁLISIS DE DATOS

Las etapas del análisis de datos son cuatro:

- Definir las pruebas apropiadas: Es necesario establecer cuáles serán las pruebas estadísticas que nos permitirán poner a prueba nuestra hipótesis.

- Preparar la base de datos: para que se encuentren en el formato adecuado para el programa estadístico que utilizaremos. Cada programa estadístico requiere que codifiquemos los datos (numéricamente) de forma específica. Excel® es bastante aceptado (con los datos de cada sujeto en las columnas y donde cada línea corresponde a un sujeto diferente).

XLSTAT funciona como un complemento perfectamente integrado en Excel, permitiéndole analizar y reformatear fácilmente sus datos dentro de Excel.

- Realizar los análisis requeridos, En esta fase es necesario realizar los análisis programados además de otros complementarios que surjan de estos primeros.

Otros programas estadísticos son:

SPSS El Statistical Package for the Social Sciences (SPSS) desarrollado en la Universidad de Chicago, es uno de los más difundidos. Constantemente se actualiza con versiones nuevas en varios idiomas. Para mantenerse al día en materia de SPSS/PASW es consultar su sitio en internet donde se puede descargar una versión de prueba de SPSS.

EPIDAT programa de epidemiologia de libre distribución desarrollado por el Servicio de Información sobre Saúde Pública de la Dirección Xeral de Saúde Pública de la Consellería de Sanidade (Xunta de Galicia) en colaboración con la Unidad de Análisis de Salud y Sistemas de Información de Salud de la Organización Panamericana de la Salud (OPS-OMS). Está dirigido a profesionales de la salud para el análisis de datos tabulados y facilitar la docencia en epidemiología y estadística. Para el manejo del programa no es necesario tener amplios conocimientos epidemiológicos ni estadísticos. Dispone de un excelente manual de ayuda con ejercicios prácticos.

Epi Info™ 7.1.5 programa informático que puede obtenerse gratuitamente de los Centros para el Control y la Prevención de Enfermedades de Atlanta (EUA) Se creó en colaboración con la Organización Mundial de la Salud como un sistema de procesamiento de textos, base de datos y estadística para la epidemiología, para usarse en ordenadores personales compatibles con IBM.

SAS(Sistema de Análisis Estadístico), fue diseñado en la Universidad de Carolina del Norte. Es muy poderoso y su utilización se ha incrementado notablemente. Es un paquete muy completo para ordenadores personales que contiene relevantes pruebas estadísticas.

MINITAB paquete que goza de popularidad por su relativamente bajo precio. Incluye un considerable número de pruebas estadísticas y cuenta con un tutorial para aprender a utilizarlo. Desde su web podemos acceder a una demo gratuita por tiempo limitado.

R entorno de software libre para gráficos y computación estadística. Se compila y ejecuta en una amplia variedad de plataformas UNIX, Windows y MacOS.

Análisis estadístico con IA

Muchos de los anteriores programas ya incorporan la IA en sus cálculos, otras herramientas de interés son:

Chat GPT Análisis de Datos IA le proporciona asistencia experta en el análisis de datos, incluyendo el manejo de datos, estadísticas descriptivas, análisis inferenciales y técnicas de análisis exploratorio

Microsoft Azure Machine Learning es una plataforma en la nube que ofrece capacidades de IA para realizar análisis estadísticos y construir modelos predictivos. Con una amplia gama de algoritmos de aprendizaje automático y estadísticas, Azure Machine Learning proporciona las herramientas necesarias para el análisis avanzado de datos.

- Interpretar los análisis.

Finalmente es necesario dar sentido a los resultados de los análisis con el objetivo de poder establecer si hemos confirmado o no nuestras hipótesis.

Para describir y resumir los resultados pueden utilizarse los siguientes instrumentos: tabulación, cálculos, gráficos y figuras.

Chat GPT Data Interpretation: en el que le subes una imagen de una tabla con resultados estadísticos, y ChatGPT responde comentando todos los resultados, explicándolos, interpretando los hallazgos y hasta proponiendo una acción o intervención. Como hemos explicado anteriormente es preciso el conocimiento previo del investigador para discernir si esta interpretación en correcta.

8.3 TABULACIÓN, REALIZACIÓN DE LA BASE DE DATOS

Una vez seleccionadas las pruebas que vamos a realizar, el primer paso para resumir los datos consiste habitualmente en agruparlos en tablas o cuadros de resumen.

El plan para los cuadros debe elaborarse en la fase de diseño de investigación. Se usa el término “cuadros ficticios” para describir los cuadros que todavía no se han llenado de datos. Durante la fase de puesta en marcha de la investigación, estos cuadros ficticios pueden llenarse con los datos existentes para ver cómo adquieren forma los resultados.

Los principales cuadros son:

- Cuadros de distribución de frecuencias. Un cuadro de distribución de frecuencias proporciona la frecuencia con que un determinado valor aparece en los datos. Al diseñar el cuadro de distribución de frecuencias correspondiente a determinados datos numéricos, se necesita establecer límites apropiados según el tipo de datos. El número de tipos o categorías es importante. Si las categorías son demasiado pequeñas, el cuadro será poco manejable. Si son demasiado grandes, la información puede perderse al estar demasiado resumida. Cuando se trata de variables continuas se establecerán intervalos de variables con un mismo rango. Si hay alguna duda, es mejor elegir inicialmente las categorías para que sean pequeñas y no grandes; si es necesario, aquellas pueden agruparse fácilmente para formar otras más grandes. Las categorías también deben ser mutuamente excluyentes.

- Cuadros de tabulación múltiple. Los cuadros de distribución de frecuencias pueden describir una variable a la vez, por ejemplo, la distribución de edades. Según los objetivos del estudio, a menudo existe la necesidad de examinar inmediatamente la relación entre varias de las variables, para una mejor descripción de los datos o para buscar las diferencias o las asociaciones pertinentes. Los cuadros de tabulación múltiple pueden ser descriptivos o analíticos. Los primeros pueden usarse para describir la muestra. Por ejemplo, un cuadro compuesto que describe los antecedentes de los sujetos, como la edad, el sexo, la ocupación, etc. Las tabulaciones múltiples analíticas pueden usarse para determinar las asociaciones o diferencias entre grupos. Si se usan porcentajes, deberán sumar un total de 100%.

- Los polígonos de frecuencias. Un primer paso común al mirar y resumir datos consiste en representarlos gráficamente en un polígono o curva de distribución de frecuencias. Cada variable se representa gráficamente con la frecuencia con la que se encuentra. La forma de esta curva de distribución dice mucho acerca de los datos y tiene implicaciones para el análisis posterior. Nos indican hacia dónde se concentran los casos (personas, organizaciones, segmentos de contenido, mediciones de polución, etc.).

Una herramienta de recogida de datos bien elaborada nos servirá para desarrollar la base de datos necesaria para trabajar con el software informático.

Los pasos sucesivos en el diseño y manejo de base de datos son los siguientes:

- Diseño de la estructura y creación de la Base de Datos (operacionalización de variables y codificación del cuestionario).

- Apertura de la base o bases de datos (Nombre y área de trabajo).

- Organización de la base de datos (Índices).

- Consultar y/o modificar los registros (Tablas y formularios).

- Listados e informes (Estadísticos).

8.4 GRÁFICOS Y FIGURAS

Las figuras mejoran la legibilidad de los resultados. Las representaciones gráficas permiten captar visualmente las características de los datos de forma rápida. Hay varios tipos de gráficas que se escogen según el tipo de variables del estudio. Los actuales sistemas computacionales como Excel, Lotus Smart Suite, Minitab, SAS, SPSS, entre otros permiten obtener representaciones gráficas de diversos conjuntos de datos. Las gráficas pueden ser tipo histograma, polígono de frecuencias, gráfica de series de tiempo, etc.

Ver ejemplos en el tema del Módulo 1 Tema 4 Bioestadística.

8.5 ESTADÍSTICA INFERENCIAL

Los investigadores deberán interrogarse si los resultados del estudio podrían generalizarse más allá del tamaño relativamente pequeño de la muestra estudiada. Esto se denomina validez o capacidad de generalización externa.

La estadística nos ayuda a hacer inferencias. Una inferencia es una generalización que se hace acerca de una población a partir del estudio de un subconjunto o muestra de esa población. Si la muestra de estudio no es representativa de la población, la inferencia que nosotros obtenemos del resultado será engañosa. La estadística analítica no será de ninguna utilidad si la muestra no es representativa, no puede corregir nuestros errores en el diseño del estudio.

Incluso con muestras seleccionadas adecuadamente, los resultados de una única muestra están sujetos a cierto grado de incertidumbre o azar. Este error de muestreo no puede eliminarse completamente, pero puede calcularse su magnitud.

De forma general se distinguen dos grandes categorías de métodos de inferencia:

- Métodos para estimación de parámetros poblacionales, que puede ser puntual o por intervalos.

- Métodos para contraste de hipótesis. Se formula la hipótesis nula (H0) y se contrasta con los datos obtenidos en la muestra, para saber si la hipótesis nula es verdadera (en ese caso, se acepta la H0) o falsa (en tal caso, se rechaza la H0).

8.5.1 Error estándar

El error estándar (EE) es una medida estadística acerca de la probabilidad de que el resultado en la muestra refleje el resultado de la población. Depende de dos factores, el tamaño de la muestra y las variaciones de las mediciones en la muestra, indicadas por la desviación estándar. Por ejemplo, el error estándar de una media se calcula como la desviación estándar dividida entre la raíz cuadrada del número de observaciones.

Por sí solo, el error estándar puede tener un significado limitado, pero puede usarse para obtener un intervalo de confianza que tiene una interpretación útil. En pocas palabras, se ha calculado que la media de la muestra, más o menos 1,96 veces su error estándar, da el intervalo de confianza de 95%, lo que significa que hay una probabilidad de solo 5% de que este intervalo no incluya la media de la población.

El error estándar (EE) puede calcularse no solo sobre una media, sino también sobre la diferencia entre dos medias, sobre un porcentaje, sobre una diferencia entre dos porcentajes y sobre un coeficiente de correlación.

8.5.2 Prueba del contraste de hipótesis

El objetivo del contraste de hipótesis es permitir generalizaciones de los resultados de nuestra muestra a la población de la que procede. Cuando el resultado de un estudio, en el que se comparan varias alternativas, muestra diferencias, el siguiente paso es estimar si dichas diferencias corresponden a diferencias reales en la población o pueden ser explicadas por azar.

Si la probabilidad de que el resultado obtenido se deba al azar es muy baja, podremos asumir que corresponda a una diferencia real en la población, aunque siempre existirá una cierta probabilidad de error. Esta probabilidad será tanto más baja cuanto mayor sea la diferencia encontrada y más grande el tamaño muestral.

Los contrastes de hipótesis sobre parámetros son recursos de inferencia estadística que partiendo de la formulación de dos hipótesis contrarias sobre el posible valor de un parámetro (o de una expresión de varios parámetros), permiten pronunciarse acerca de la veracidad de una de ellas.

El contraste de hipótesis se plantea habitualmente bajo el supuesto de 2 hipótesis contrapuestas, una hipótesis nula conservadora que sostiene la ausencia de diferencias (p. ej., el porcentaje de curación con el nuevo tratamiento es igual al que se obtiene con un tratamiento clásico), frente a una hipótesis alternativa novedosa que defiende la existencia de diferencias (p. ej. el porcentaje de curación con el nuevo tratamiento es mayor).

Para poder aceptar la hipótesis alternativa debe rechazarse la hipótesis nula, lo cual se consigue cuando la diferencia o efecto encontrado en el estudio no parece debido al azar.

El uso de la hipótesis de nulidad en la labor científica se ha comparado con el proceso judicial de suponer la inocencia hasta que se demuestre lo contrario. En esa misma línea de razonamiento, pueden cometerse dos tipos de errores en la prueba de la hipótesis de nulidad en la metodología de investigación, y la determinación estadística de si el resultado pudiera deberse al azar.

- El primero es cuando rechazamos la hipótesis nula y esta es cierta. Esto es similar al error en el proceso judicial de rechazar la inocencia y condenar a un acusado inocente. En el idioma estadístico, esto se conoce como error de tipo I.

- La imposibilidad de rechazar la hipótesis nula cuando no es verdadera se denomina error de tipo II. En el proceso judicial, esto sería similar a no lograr la condena de un acusado que en realidad es culpable.

Diversos procedimientos estadísticos (basados en los datos del estudio y en el tamaño muestral) nos permiten calcular la probabilidad de que dicho resultado se produzca por azar. El tipo de prueba a realizar dependerá del tipo de variables del estudio.

Más información en Contraste de hipótesis

Por convención, si esta probabilidad es menor del 5% (p<0,05) se considera que no se debe al azar, en ese caso se rechaza la hipótesis nula y se acepta la alternativa.

En los programas informáticos (SPSS, Epi Info, EPIDAT, etc) en el resultado aparecerá que p < 0.05 o 0.01, es decir, la diferencia es estadísticamente significativa y no se debe al azar.

Si la probabilidad de que los resultados sean debidos al azar es mayor (p=0,05), en estos casos el contraste de hipótesis no permite rechazar la hipótesis nula. En la mayoría de los programas informáticos en el resultado aparecerá p > 0.05 o 0.01, la diferencia no es estadísticamente significativa.

8.6 LO QUE LAS PRUEBAS ESTADÍSTICAS NOS DICEN

8.6.1 Probabilidad

En la ciencia no hay ninguna certidumbre, hay probabilidades. Lo que es cierto acerca de la ciencia es la incertidumbre. En la metodología científica, tratamos de reducir al mínimo la probabilidad de encontrar una asociación cuando en realidad no existe ninguna, y de reducir al mínimo la probabilidad de pasar por alto u omitir una asociación cuando en realidad sí existe.

No podemos eliminar esta probabilidad de error, sin embargo, la estadística analítica puede darnos un cálculo de su magnitud. La probabilidad de cometer un error depende del tamaño de la muestra estudiada para probar la hipótesis de nulidad. Cuanto mayor es el tamaño de la muestra, tanto menos probable será la probabilidad de cometer un error. Esta es la razón por la cual la determinación del tamaño de la muestra es una parte fundamental del diseño de investigación.

8.6.2 Significación estadística

Las pruebas de significación estadística se basan en la lógica y en el sentido común.

Una prueba de significación estadística calcula la probabilidad de que un resultado observado de un estudio, por ejemplo, una diferencia entre dos grupos o una asociación, se deba al azar y por consiguiente, de que no pueda obtenerse ninguna inferencia del mismo.

Que una diferencia tenga la probabilidad de ser real y no debida al azar se basa en gran parte en tres criterios:

- Magnitud de la diferencia observada. Es razonable esperar que cuanto mayor sea la diferencia, tanto más probable es que no se deba al azar.

- Grado de variaciones de los valores obtenidos en el estudio. Si los valores se sitúan dentro de un intervalo demasiado amplio, es más probable que las diferencias de las medias se deban a las variaciones del azar.

- Tamaño de la muestra estudiada. Cuanto mayor es el tamaño de la muestra, es más probable que el resultado obtenido refleje los resultados en la población.

Lo que los estadísticos hacen es convertir esta lógica sencilla, mediante las matemáticas, en una fórmula cuantitativa para describir el grado de probabilidad.

Cuando se analizan los datos, fijamos un valor arbitrario para lo que podemos aceptar como alfa o grado de significación estadística. Luego, las pruebas estadísticas determinan el valor P, que es la probabilidad de que una diferencia o una asociación tan grande como la observada puedan haber ocurrido solo por efecto del azar.

Habitualmente, se considera que un resultado tiene poca probabilidad de deberse al azar, o de ser estadísticamente significativo, si el valor P es inferior a 5% (P inferior a 0,05) y se dice que es sumamente significativa si el valor P es inferior a 0,01.

Es importante tener presente que la magnitud de P o la probabilidad de que un resultado se haya producido por el azar depende de dos valores. Estos son la magnitud de la diferencia y el tamaño de la muestra estudiada.

8.7 MEDIDAS COMUNES EN EPIDEMIOLOGÍA

Los resultados de los estudios epidemiológicos deben ser expresados en forma de medidas de salud o enfermedad, con las que indicamos frecuencias, diferencias, asociación, riesgo o impacto. La forma de presentar los resultados va a depender del tipo de estudio realizado, pero sobre todo de las características de la variable o variables de interés. En epidemiología, el escenario más simple lo constituye el estudio de dos variables discretas dicotómicas. Este escenario corresponde al supuesto habitual de estudio de la asociación entre presencia-ausencia de un determinado factor de exposición y presencia-ausencia de enfermedad. Para analizar esta relación contamos con una serie de medidas de frecuencia, riesgo e impacto.

8.7.1 Porcentajes, proporciones, razones y tasas

Las tasas y las razones representan algunas de las herramientas básicas que se usan indirectamente para valorar los fenómenos de los individuos y las poblaciones.

Por ejemplo, en la medición de la mortalidad materna. Si relacionamos el número de mujeres que mueren debido al embarazo y al parto, con el número de mujeres que tienen nacidos vivos, calculamos una razón. Si las relacionamos con todas las mujeres en el período fértil durante un tiempo determinado, calculamos una tasa.

- Un porcentaje es el número de unidades con una determinada característica, dividido entre el número total de unidades en la muestra y multiplicado por 100.

- Una proporción es una expresión numérica que compara una parte de las unidades del estudio con la totalidad. Una proporción puede expresarse como una fracción (por ejemplo, una proporción de 2/5) o un decimal (por ejemplo 0,40).

- Una razón es la expresión numérica de la relación entre un conjunto de frecuencias y otro. Un ejemplo es la razón entre el número de varones y el de mujeres en una muestra.

- Una tasa es la expresión numérica de la frecuencia de una enfermedad en una población determinada, medida en un período especificado. Dos tasas de uso frecuente en las ciencias de la salud son la incidencia y la prevalencia.

- La tasa de incidencia está relaciona con el número de casos nuevos de una enfermedad en una población dentro de un período.

- La tasa de prevalencia relaciona el número total de casos con una enfermedad en una población en un momento dado.

Incidencia y prevalencia son las expresiones de frecuencia de enfermedad más utilizadas en la literatura médica. Es importante distinguir entre ambas.

La incidencia es el número de nuevos casos que han ocurrido durante un intervalo de tiempo, dividido entre el tamaño de la población en riesgo al comienzo del intervalo. Esta información es habitualmente obtenida de estudios de cohortes y expresada en forma de tasas (/10.000 o 100.000). Podemos diferenciar dos tipos de incidencias, la incidencia acumulada y la densidad de incidencia. La incidencia acumulada corresponde al cociente entre el número de casos nuevos y la población en riesgo. Se utiliza cuando no se espera que la enfermedad se repita en un mismo sujeto y la población en riesgo sea estable. (p. ej. Frecuencia de meningitis en 1 año). La densidad de incidencia corresponde al cociente entre el número de casos nuevos y la suma de los periodos de tiempo que es seguida la población en riesgo. (EJ. Casos- año) se emplea cuando el riesgo de enfermedad es proporcional al tiempo de seguimiento. Cada sujeto puede tener más de un caso y el tiempo de seguimiento de cada sujeto es diferente. (Frecuencia de catarros en niños que acuden a una guardería a lo largo de un curso)

La prevalencia es el número de individuos con una enfermedad o característica en un determinado punto en el tiempo, dividido por la población en riesgo en ese momento. Se calcula habitualmente a partir de estudios transversales y se expresa como una proporción (%).

Ambas medidas expresan información complementaria. Una enfermedad con alta incidencia y con alta mortalidad tendrá una baja prevalencia en la población. Alternativamente, una enfermedad con una baja incidencia tendrá una alta prevalencia, si su tasa de mortalidad es baja. El efecto de la mortalidad en la prevalencia puede repercutir en las características de las muestras seleccionadas para participar en un estudio, ya que la población susceptible de entrar en un estudio con casos prevalentes será una selección de pacientes con mejor pronóstico y menor presencia de factores de riesgo, que la población identificada en un estudio con casos incidentes.

8.7.2 Medidas de riesgo

Mientras la incidencia y prevalencia expresan la frecuencia de enfermedad en grupos concretos de pacientes, otras medidas permiten comparar las diferencias de frecuencia entre dos grupos distintos o estimar el incremento de riesgo asociado a una exposición concreta. Las principales medidas de riesgo son el riesgo relativo y la odds ratio (razón de ventajas).

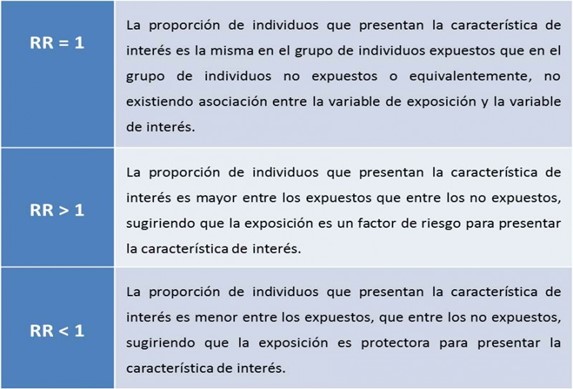

El riesgo relativo (RR) también se puede llamar Incidencia Acumulada o Riesgo Proporcional y se calcula dividiendo la incidencia en el grupo de sujetos expuestos a un determinado factor de riesgo o protección, entre la incidencia en el grupo no expuesto.

Cálculo del Riesgo relativo = Incidencia grupo expuesto / Incidencia grupo control

Sólo puede ser calculado en estudios de seguimiento y mide la fuerza de la asociación entre exposición y enfermedad. Adopta valores entre 0 e infinito, menores de 1 para factores de protección y mayores para factores de riesgo. Un RR de “1” supone el valor nulo (el riesgo en los 2 grupos es igual), cuanto más se aleje el valor de 1, por arriba o por abajo, mayor será la fuerza de la asociación. RR = 1

La Reducción Relativa del Riesgo (RRR), es el complemento del Riesgo Relativo (RR). Se interpreta como el porcentaje de reducción del riesgo de eventos en el grupo expuesto con respecto al riesgo de eventos en el grupo control.

Cálculo de RRR: (1 - RR) x 100

En los estudios sin seguimiento longitudinal como estudios de casos y controles, como no es posible calcular la incidencia, no puede calcularse el riesgo relativo. Por ello, para estimar el riesgo se calcula la odds ratio (OR), que compara la odds de exposición (probabilidad de estar expuesto a un factor de riesgo dividida entre su complementario) en el grupo con enfermedad y la odds de exposición en el grupo control sin enfermedad, y que se calcula dividiendo ambas odds.

La interpretación de la OR es similar a la del RR; “1” supone el valor nulo, valores menores de 1 indican disminución del riesgo y mayor aumento del riesgo.

OR = 1

Hay que tener en cuenta que sólo cuando la enfermedad estudiada es muy poco frecuente el RR y la OR ofrecen valores similares.

8.7.3 Medidas de impacto

Aunque con las medidas anteriores podemos estimar el riesgo que genera un factor de exposición sobre un efecto o enfermedad, esas medidas no nos informan del impacto que dicha exposición puede originar en el conjunto de casos existentes en una población. Esta información podemos extraerla de otras medidas, como la diferencia de riesgos o la proporción atribuible.

Ambas medidas son estimadores del efecto absoluto que ejerce la exposición sobre la incidencia de un suceso en el grupo expuesto o en la población total. Se usan para evaluar la importancia clínica o sanitaria de una exposición y nos informan del porcentaje de incidencia que se reduciría si se eliminara el referido factor de exposición. Son por consiguiente muy útiles, tanto en la clínica como en salud pública, para cuantificar el posible impacto de diferentes medidas de intervención.

La diferencia de riesgos (DR) se calcula restando de la incidencia en el grupo expuesto al factor de riesgo, sobre la incidencia en el grupo no expuesto. Adopta valores entre 0 y 1 (entre 0 y 100 si se expresa en tantos por ciento), constituyendo el “0” el valor nulo de ausencia de diferencias. La DR ofrece información independiente del riesgo relativo y puede variar, entre distintos grupos de pacientes, en función del riesgo propio de cada grupo. Así, podemos encontrarnos que factores que muestran un riesgo relativo muy alto apenas presenten modificaciones en la diferencia de riesgos, porque el riesgo en la población (al margen de la contribución de dicho factor) sea muy bajo.

La proporción atribuible (PA), también conocida como riesgo atribuible, fracción etiológica, fracción atribuible o población de riesgo atribuible, se define como la proporción de casos nuevos de la enfermedad en el grupo de sujetos expuestos, que son atribuibles al factor de riesgo de interés. Se calcula dividiendo la diferencia de riesgos, anteriormente calculada, entre la incidencia en el grupo expuesto. Una extensión de esta medida es la proporción atribuible poblacional, que extiende la proporción de casos nuevos a toda la población, tanto expuestos como no expuestos.

Los resultados de los ensayos clínicos suelen reflejar el efecto beneficioso de intervenciones terapéuticas que reducen el riesgo en el grupo expuesto. Por ello, la diferencia de riesgos en este supuesto, conocida como reducción absoluta del riesgo (RAR), se calcula en sentido contrario, restando del riesgo en el grupo control el riesgo en el grupo de intervención.

Cálculo de RAR:

Incidencia grupo control – Incidencia grupo experimental

Se interpreta como la reducción del riesgo de sufrir un evento en porcentaje (por ejemplo; tomar un fármaco respecto a no tomarlo).

Otra medida de impacto aplicable a estos estudios, de gran interés clínico, es el número necesario a tratar (NNT), que corresponde al inverso de la RAR (1/RAR), y que nos informa del número de pacientes que deberían ser tratados con la intervención terapéutica para que un caso se viera beneficiado, evitando un evento desfavorable.

NNT = (1 / RAR) x 100

Ejemplo de dos diferentes estudios donde se pueden ver los resultados de las diferentes medidas anteriores

Otros sitios web con información en estadística y metodología de investigación:

Fisterra Metodología de la Investigación

Análisis de los estudios de cohortes. Medidas de riesgo e impacto

Análisis de estudios de Casos y controles. Odds Ratio

Análisis de los ensayos clínicos

Estos cálculos pueden realizarse con una calculadora Excel accesible en goo.gl/ke8sUc Este fichero puede abrirse online o descargarse. Dispone de 3 hojas accesibles con 3 pestañas en la parte inferior para hacer cálculos con estudios de cohortes, casos y controles y ensayos clínicos. Basta introducir los recuentos en la tabla marcada y el programa ofrece los cálculos.

BIBLIOGRAFÍA

- Asociación Médica Mundial.Declaración de Helsinki de la Asociación Médica Mundial. Principios éticos para las investigaciones médicas en seres humanos. Anales del Sistema Sanitario de Navarra. 2008; 24(2):209-212.

- Casado M., Vilà A. Declaración Universal sobre Bioética y Derechos Humanos de la Unesco y la discapacidad, 1ª ed. Barcelona: Edicions Universitat Barcelona; 2014.

- Consejo de Organizaciones Internacionales de Ciencias Medica. International Ethical Guidelines for Biomedical Research Involving Human Subjects. Ginebra: CIOMS; 2002

- Sinobas P E. Manual de investigación cuantitativa para enfermería. Oviedo: Federación de Asociaciones de Enfermería Comunitaria y Atención Primaria; 2011.

- Fathalla Mahmoud F. Guía práctica de investigación en salud. Vol. 620. Washington DC: Organización Panamericana de la Salud, 2008. 247 p.

- Galindo-Domínguez, H. Estadística para no estadísticos: una guía básica sobre la metodología cuantitativa de trabajos académicos. 1ªed. Alicante:3ciencias, 2020. DOI: https://doi.org/10.17993/EcoOrgyCso.2020.59

- Grupo de trabajo sobre GPC. Elaboración de Guías de Práctica Clínica en el Sistema Nacional de Salud. Actualización del Manual Metodológico. Madrid: Ministerio de Sanidad, Servicios Sociales e Igualdad; 2016

- Hernández Sampieri R, Fernández Collado C BLP. Metodología de la investigación. 5a ed. México, D.F: McGraw-Hill; 2010. 613 p.

- Mirón Canelo JA, Alonso Sardón M I. Metodología de investigación en Salud Laboral. Med y Segur del Trab. 2010;56(221):347–65.

- Instituto Aragonés de Ciencias de la Salud. Manual Metodológico. Madrid: Plan Nacional para el SNS del MSC.

- Instituto Aragonés de Ciencias de la Salud-I+CS; 2016.

- Ochoa Sangrador C., Molina Arias M., Ortega Páez E. Inferencia estadística: contraste de hipótesis. (Internet) Evid Pediatr, 2020; 16:11. Disponible en: https://evidenciasenpediatria.es/articulo/7537/inferencia-estadistica-contraste-de-hipotesis (consultado 20 agosto 2024)

- Parreño Urquizo A. Metodología de investigación en salud. Instituto de Investigaciones. Riobamba: Escuela Superior Politécnica de Chimborazo; 2016.

- Pita Fernández, S. Epidemiología. Conceptos básicos. En: Tratado de Epidemiología Clínica. Madrid; DuPont Pharma, S.A.; Universidad de Alicante: 1995.

- Royo Bordonada M.Á, Damián Moreno J. Método epidemiológico. Madrid: ENS Instituto Salud CarlosIII;2009.

- Salamanca Castro AB. El AEIOU de la investigación. Enero 2013. Madrid: FUDEN; 2013. 494 p.

- Vicente Edo, MJ., Gavín Benavent, P., Cantero Muñoz, P., Novella Arribas, B., Reviriego Rodrigo, E., Toledo Chávarri, A., Triñanes Pego, Y. Evaluación de Tecnologías Sanitarias. Material de Formación para Pacientes y Ciudadanía. Versión completa. Madrid: Ministerio de Sanidad; Zaragoza: Instituto Aragonés de Ciencias de la Salud; 2020. 113 p.